Utiliser ChatGPT, Claude ou Gemini est devenu très simple : on ouvre un navigateur, on écrit une question, et le modèle répond depuis le cloud. Mais une autre approche devient de plus en plus populaire : faire tourner une IA directement sur son PC.

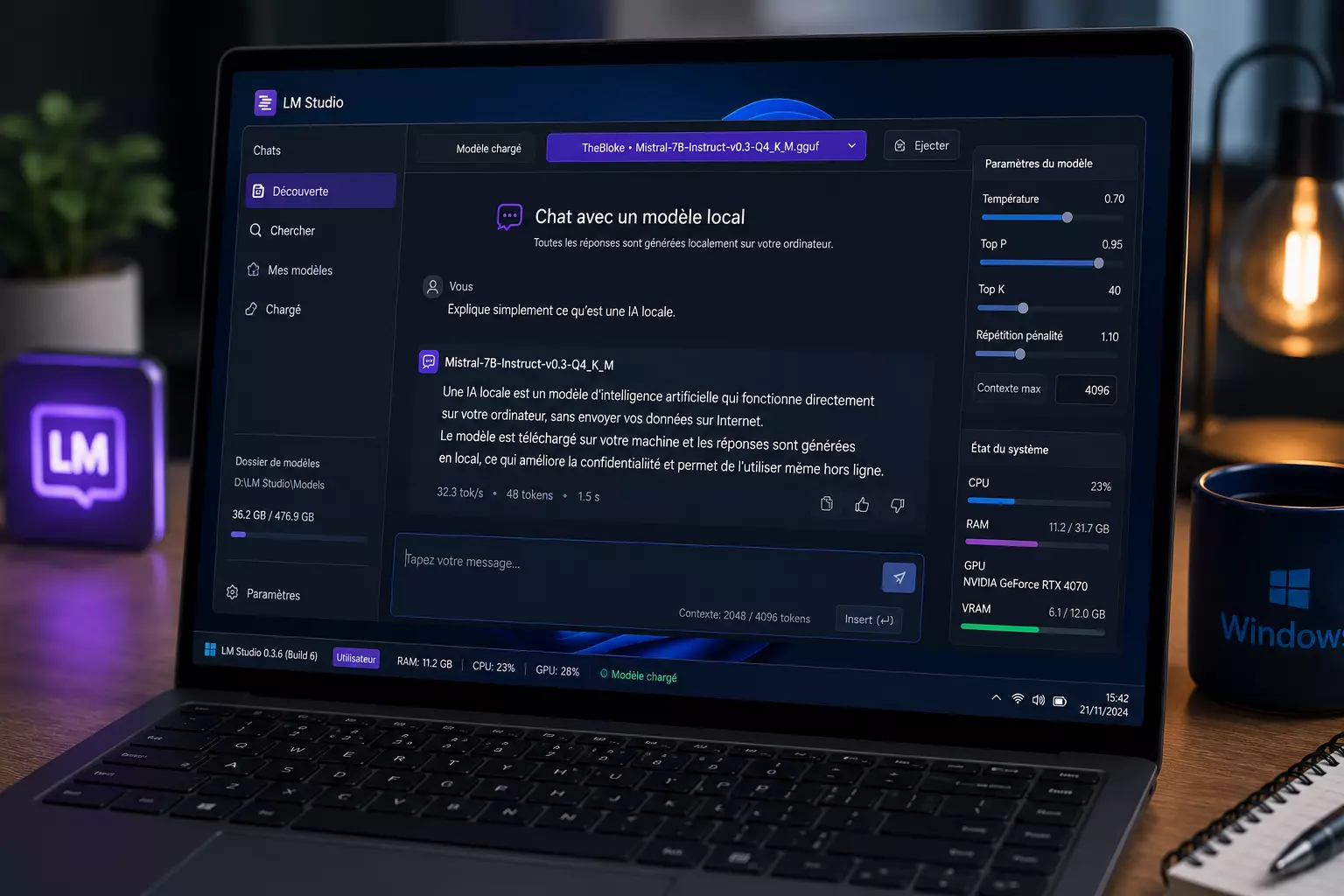

C’est exactement ce que permet LM Studio. Le logiciel propose une interface simple pour télécharger, lancer et tester des modèles de langage en local, sans forcément passer par la ligne de commande. LM Studio est disponible sur Windows, macOS et Linux, et propose une application pensée pour expérimenter avec des LLM directement sur son ordinateur.

Dans ce guide, on va voir comment installer LM Studio sur Windows, télécharger un premier modèle et lancer une conversation avec une IA locale.

C’est quoi LM Studio ?

LM Studio est une application qui permet d’exécuter des modèles de langage sur son propre ordinateur. En clair, au lieu d’envoyer chaque message à un serveur distant, vous pouvez charger un modèle directement sur votre PC et discuter avec lui depuis une interface locale.

LM Studio intègre aussi un outil de recherche et de téléchargement de modèles compatibles depuis Hugging Face. On peut chercher un modèle par mot-clé, par nom précis ou même en collant une URL Hugging Face dans la barre de recherche.

LM Studio peut servir à :

- tester des modèles open source ;

- discuter avec une IA sans passer par un service cloud ;

- résumer des textes localement ;

- comparer plusieurs modèles ;

- utiliser une IA hors ligne après téléchargement du modèle ;

- créer un petit serveur local compatible avec certaines applications IA.

Pourquoi utiliser une IA en local ?

Le principal intérêt est la confidentialité. Une fois le modèle téléchargé, LM Studio indique que le modèle peut fonctionner localement et que les messages saisis dans le chat ne quittent pas l’appareil. Pour le chat avec documents, LM Studio précise aussi que les documents restent sur la machine et que le traitement est réalisé localement.

Cela ne veut pas dire qu’une IA locale est toujours meilleure qu’un modèle cloud. Les grands modèles comme ChatGPT, Claude ou Gemini restent souvent plus puissants, plus rapides et plus polyvalents. Mais pour certains usages, le local a de vrais avantages.

Les avantages

- meilleure confidentialité ;

- fonctionnement possible hors ligne ;

- pas forcément besoin d’abonnement ;

- test de modèles open source ;

- contrôle sur les fichiers utilisés ;

- apprentissage concret du fonctionnement des LLM.

Les limites

- modèles parfois moins performants que les services cloud ;

- besoin de RAM et parfois de VRAM ;

- téléchargement de fichiers volumineux ;

- réponses plus lentes sur les petits PC ;

- résultats variables selon le modèle choisi.

Configuration recommandée pour Windows

Avant d’installer LM Studio, il faut vérifier que votre PC est suffisamment récent. Sur Windows, LM Studio prend en charge les systèmes x64 et ARM, notamment les machines Snapdragon X Elite. Pour les PC x64, le processeur doit supporter les instructions AVX2. LM Studio recommande aussi au moins 16 Go de RAM et un GPU avec 4 Go de VRAM dédiée pour une meilleure expérience.

| Composant | Recommandation TechPi |

|---|---|

| Système | Windows 10 ou Windows 11 récent |

| CPU | Intel Core / AMD Ryzen récent avec AVX2 |

| RAM | 16 Go minimum, 32 Go conseillé |

| GPU | Optionnel, mais GPU dédié recommandé |

| VRAM | 4 Go minimum, 8 Go ou plus conseillé |

| Stockage | SSD avec 50 Go libres ou plus |

| Connexion | Nécessaire pour télécharger les modèles |

Pour simplement tester LM Studio, 16 Go de RAM peuvent suffire. Pour un usage plus confortable, surtout avec plusieurs applications ouvertes, 32 Go de RAM restent préférables.

Étape 1 — Télécharger LM Studio

La première étape consiste à télécharger LM Studio depuis le site officiel. La page de téléchargement propose les versions macOS, Windows et Linux.

Évitez les sites tiers ou les faux installateurs. Comme pour tout logiciel lié à l’IA, il vaut mieux passer par la source officielle afin de limiter les risques de fichiers modifiés ou indésirables.

Une fois l’installateur Windows téléchargé, lancez-le puis suivez les étapes affichées à l’écran. L’installation ne demande pas de manipulation particulière.

Étape 2 — Choisir l’emplacement des modèles

Après l’installation, LM Studio peut demander où stocker les modèles téléchargés. Ce point est important, car les fichiers peuvent vite prendre plusieurs gigaoctets.

Si votre PC possède deux disques, l’idéal est de choisir un SSD avec beaucoup d’espace libre. Évitez de tout stocker sur un petit SSD système déjà presque plein.

TechPi recommande de prévoir au moins 50 à 100 Go libres si vous voulez tester plusieurs modèles.

Étape 3 — Télécharger un premier modèle

Une fois LM Studio ouvert, allez dans l’espace de découverte ou de recherche des modèles. LM Studio propose un téléchargeur intégré permettant de récupérer des modèles compatibles depuis Hugging Face.

Pour débuter, ne choisissez pas un modèle trop lourd. Un petit modèle sera plus rapide à télécharger, plus simple à lancer et moins exigeant pour votre PC.

Quel modèle choisir pour débuter ?

Pour un premier test, cherchez un modèle compact de type :

- 3B ;

- 4B ;

- 7B ;

- 8B.

Ces chiffres correspondent généralement au nombre de paramètres du modèle. Plus le nombre est élevé, plus le modèle peut être lourd et exigeant.

Pour une première installation, un modèle autour de 7B ou 8B est souvent un bon compromis si vous avez 16 ou 32 Go de RAM.

Étape 4 — Comprendre les variantes Q4, Q5, Q8

Quand vous téléchargez un modèle, vous pouvez parfois voir plusieurs variantes : Q4, Q5, Q8, parfois avec des noms comme Q4_K_M.

Ces variantes correspondent à des niveaux de quantification. Pour simplifier, la quantification réduit la taille du modèle afin de le faire tourner plus facilement sur un PC grand public.

LM Studio documente aussi l’usage de niveaux de quantification comme Q4_K_M dans ses outils de téléchargement de modèles.

Recommandation simple

| Variante | À choisir si… |

|---|---|

| Q4 | Vous voulez un modèle léger et facile à lancer |

| Q5 | Vous cherchez un meilleur équilibre qualité/performance |

| Q8 | Vous avez plus de RAM/VRAM et voulez une meilleure qualité |

| FP16 | À éviter pour débuter, beaucoup plus lourd |

Pour commencer, TechPi recommande souvent une variante Q4 ou Q5. C’est le choix le plus simple pour tester l’IA locale sans saturer la machine.

Étape 5 — Charger le modèle

Une fois le modèle téléchargé, il faut le charger dans LM Studio. Cette étape peut prendre quelques secondes ou plus selon la taille du modèle, votre SSD, votre RAM et votre carte graphique.

Si le modèle est trop lourd, LM Studio peut refuser de le charger ou devenir très lent. Dans ce cas, il vaut mieux télécharger une variante plus légère.

Signes que le modèle est trop lourd :

- chargement très long ;

- PC qui ralentit fortement ;

- mémoire saturée ;

- ventilateurs très bruyants ;

- réponses extrêmement lentes ;

- erreur au lancement du modèle.

Étape 6 — Lancer votre première conversation

Une fois le modèle chargé, ouvrez l’onglet de chat et posez une question simple.

Exemples :

Résume en 5 lignes le fonctionnement d’un PC IA.

Explique la différence entre CPU, GPU et NPU à un débutant.

Donne-moi une checklist avant d’acheter un PC portable pour l’IA locale.

Le premier test sert surtout à vérifier que tout fonctionne. Ensuite, vous pourrez tester des prompts plus longs, des documents ou différents modèles.

Exemple de prompt pour bien commencer

Voici un prompt simple à utiliser pour tester votre modèle local :

Tu es un assistant pédagogique. Explique simplement ce qu’est une IA locale, avec des exemples concrets, sans jargon inutile. Termine par trois conseils pour débuter.

Ce type de prompt permet de vérifier la qualité du modèle, sa clarté et sa capacité à structurer une réponse.

Peut-on utiliser LM Studio sans Internet ?

Oui, mais avec une nuance importante. Vous avez besoin d’Internet pour télécharger LM Studio et récupérer les modèles. Ensuite, une fois le modèle présent sur votre machine, LM Studio indique qu’il peut fonctionner localement et que vous pouvez l’utiliser hors ligne.

C’est l’un des grands intérêts de l’IA locale : pouvoir continuer à travailler même sans connexion, tant que les modèles nécessaires sont déjà téléchargés.

Peut-on discuter avec des documents ?

LM Studio permet aussi de travailler avec des documents dans certains usages. Selon sa documentation, lorsqu’un document est glissé dans LM Studio pour discuter avec lui ou effectuer du RAG, le document reste sur la machine et le traitement est réalisé localement.

C’est intéressant pour résumer des notes, analyser des textes ou poser des questions sur un document sans l’envoyer vers un service cloud.

Attention toutefois : cela ne dispense pas de vérifier les réponses. Une IA locale peut se tromper, oublier des détails ou mal interpréter un passage. Pour un document important, il faut toujours relire la source.

LM Studio peut aussi servir de serveur local

LM Studio ne sert pas seulement à discuter dans une interface graphique. L’application peut aussi lancer un serveur local depuis son onglet développeur, sur localhost ou sur le réseau. LM Studio indique que ses API peuvent être utilisées via REST, des bibliothèques comme lmstudio-js et lmstudio-python, ainsi que des endpoints compatibles OpenAI ou Anthropic.

Cette fonction intéresse surtout les développeurs. Elle permet de connecter des scripts, des outils ou des applications à un modèle local.

Pour un débutant, ce n’est pas indispensable. Mais c’est bon à savoir si vous voulez aller plus loin.

Les erreurs fréquentes à éviter

Télécharger un modèle trop lourd

C’est l’erreur la plus courante. Pour commencer, choisissez un petit modèle en Q4 ou Q5. Un modèle plus gros n’est pas forcément plus utile si votre PC ne peut pas le faire tourner correctement.

Oublier l’espace disque

Les modèles peuvent prendre beaucoup de place. Si vous testez plusieurs variantes, le stockage peut se remplir rapidement. Pensez à supprimer les modèles inutilisés.

Confondre RAM et VRAM

La RAM aide le système et les modèles qui tournent sur CPU. La VRAM correspond à la mémoire de la carte graphique. Pour de bonnes performances avec accélération GPU, la VRAM devient très importante.

Penser qu’une IA locale remplace toujours ChatGPT

Un modèle local est pratique, mais il peut être moins performant qu’un grand modèle cloud. Il faut le voir comme un outil complémentaire, pas comme un remplacement automatique.

Ne pas vérifier les réponses

Comme tous les modèles IA, un LLM local peut halluciner. Il peut inventer une source, se tromper dans un calcul ou donner une réponse convaincante mais fausse.

Que faire si LM Studio est lent ?

Si les réponses sont trop lentes, essayez ces solutions :

- Fermez les applications inutiles.

- Utilisez un modèle plus petit.

- Téléchargez une variante Q4 au lieu de Q8.

- Réduisez la taille du contexte si l’option est disponible.

- Vérifiez que votre GPU est bien utilisé.

- Libérez de l’espace sur le SSD.

- Redémarrez le PC si la mémoire est saturée.

Sur un PC portable, branchez aussi l’ordinateur au secteur. Certains modèles réduisent fortement les performances sur batterie.

Quelle configuration choisir pour LM Studio ?

| Usage | Configuration conseillée |

|---|---|

| Découverte | 16 Go RAM, petit modèle Q4 |

| Usage régulier | 32 Go RAM, GPU avec 8 Go VRAM |

| Développement | 32 à 64 Go RAM, GPU RTX conseillé |

| IA locale avancée | 64 Go RAM, GPU avec 16 Go VRAM ou plus |

| Mobilité | PC portable récent, bon refroidissement |

Pour TechPi, le meilleur compromis en 2026 reste un PC avec 32 Go de RAM, un SSD d’au moins 1 To et un GPU dédié si vous voulez utiliser régulièrement des modèles locaux.

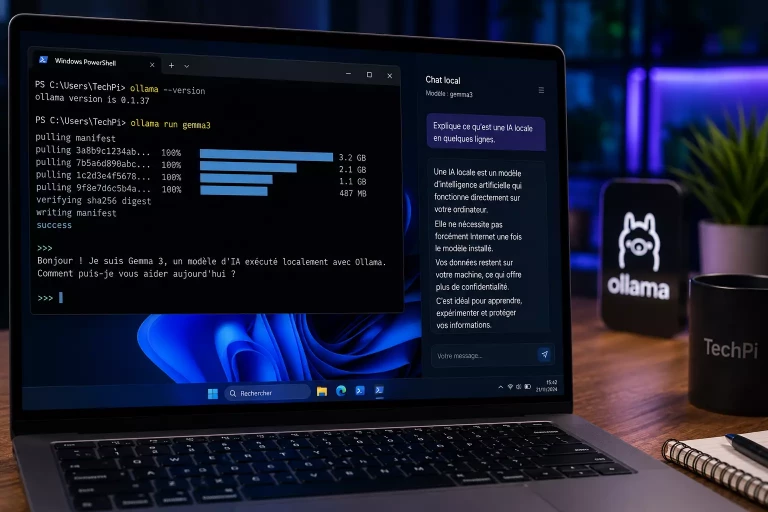

LM Studio, Ollama ou ChatGPT : que choisir ?

LM Studio est très pratique pour débuter, car son interface graphique rend le téléchargement et le test de modèles plus accessibles.

Ollama est souvent apprécié par les utilisateurs plus techniques, notamment pour les usages en ligne de commande et les intégrations simples.

ChatGPT reste plus puissant pour beaucoup d’usages généraux, mais il fonctionne principalement via le cloud.

| Outil | Meilleur usage |

|---|---|

| LM Studio | Débuter facilement avec une interface graphique |

| Ollama | Utilisation technique, terminal, automatisation |

| ChatGPT | Qualité générale, multimodal, productivité cloud |

| Open WebUI | Interface web locale plus avancée |

Pour un premier pas dans l’IA locale sur Windows, LM Studio est probablement l’un des choix les plus simples.

Verdict TechPi

LM Studio est une très bonne porte d’entrée pour découvrir l’IA locale sur Windows. L’installation est simple, l’interface est accessible et le téléchargement de modèles depuis Hugging Face évite de devoir manipuler manuellement des fichiers complexes.

Il faut toutefois garder des attentes réalistes. Un petit modèle local ne remplacera pas toujours un grand modèle cloud. Les performances dépendent fortement de votre RAM, de votre GPU, de votre VRAM et du modèle choisi.

Notre conseil : commencez avec un modèle léger en Q4 ou Q5, testez quelques prompts simples, puis augmentez progressivement la taille des modèles si votre PC suit. Pour un usage confortable, visez 32 Go de RAM et un GPU dédié avec au moins 8 Go de VRAM.

FAQ

LM Studio indique sur son site que l’application est gratuite pour un usage personnel et professionnel, sous réserve de ses conditions d’utilisation.

Non, ce n’est pas toujours obligatoire. Mais une carte graphique dédiée améliore fortement l’expérience avec certains modèles. LM Studio recommande un GPU avec au moins 4 Go de VRAM dédiée pour Windows.

Oui, une fois le modèle téléchargé. LM Studio indique que les modèles téléchargés peuvent fonctionner localement et que les messages du chat ne quittent pas l’appareil.

Choisissez un petit modèle en 3B, 4B, 7B ou 8B, idéalement en Q4 ou Q5. Cela permet de tester l’IA locale sans bloquer votre PC.

Pas complètement. LM Studio permet d’utiliser des modèles locaux, mais les grands modèles cloud restent souvent plus performants. LM Studio est surtout intéressant pour la confidentialité, l’expérimentation et le fonctionnement hors ligne.