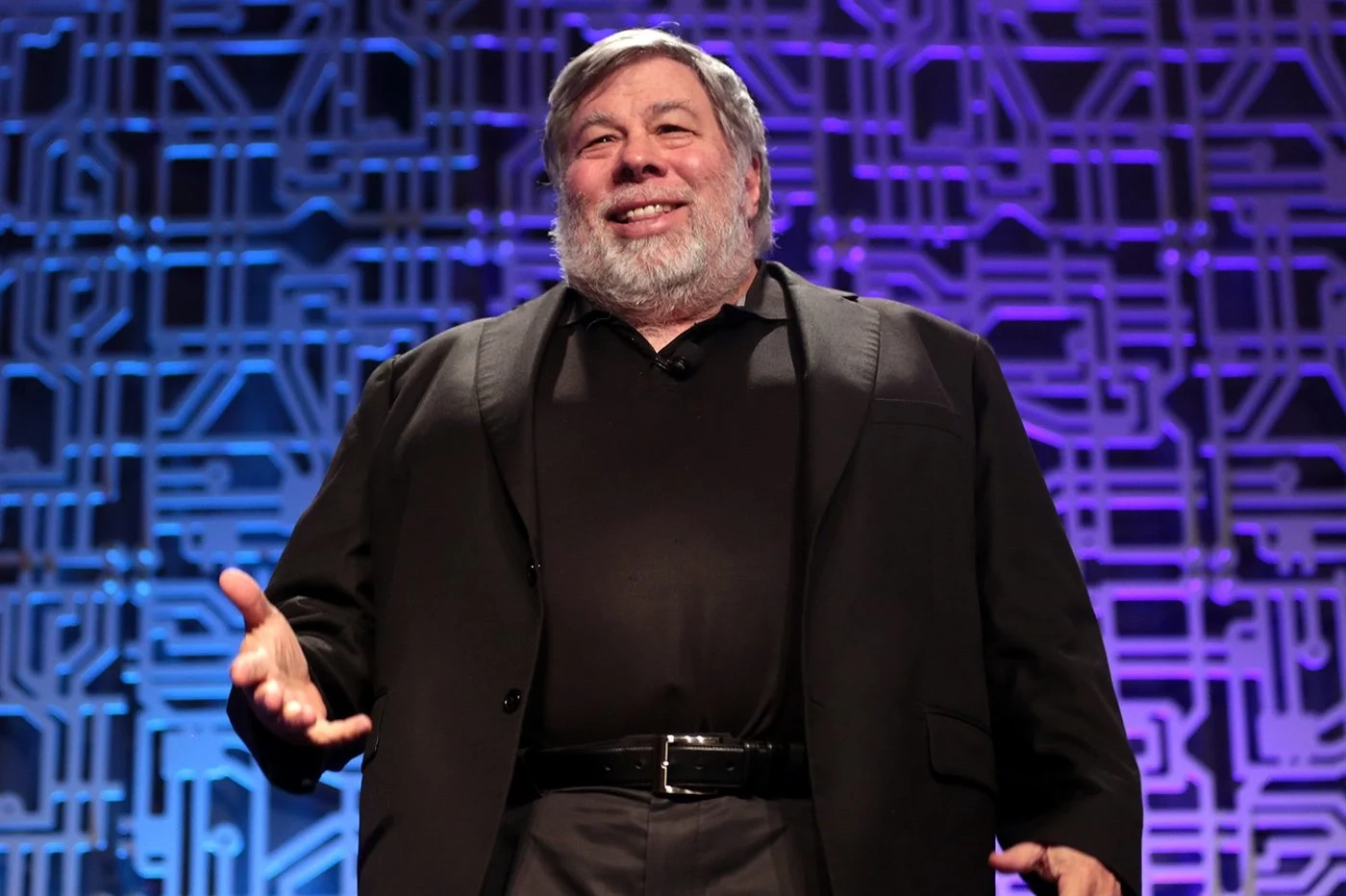

Steve Wozniak, cofondateur d’Apple, a de nouveau pris ses distances avec l’intelligence artificielle. Il dit ne pas en être « fan » et pointe un défaut central : son manque de fiabilité. Selon lui, ces systèmes donnent souvent l’illusion de comprendre, sans offrir la compréhension humaine que les utilisateurs attendent. Cette mise en garde intervient alors que la course à l’IA s’accélère et que les grands laboratoires promettent des avancées toujours plus rapides.

La déclaration, rapportée par Fox Business, s’inscrit dans une évolution plus large de la position de Wozniak. L’ingénieur, figure fondatrice de l’informatique personnelle, n’adopte pas un rejet absolu de la technologie. En revanche, il alerte sur les limites actuelles de l’IA, qu’il décrit comme puissante mais privée d’intention réelle. En clair, la machine peut produire des réponses rapides, mais elle ne sait pas vraiment ce qu’elle dit.

Ainsi, sa critique touche un point sensible du débat public. Les outils d’IA générative séduisent par leur vitesse et leur aisance. Pourtant, ils restent capables d’erreurs, de biais et d’affirmations infondées. Pour Wozniak, ce décalage ressemble à un moteur puissant monté sur un tableau de bord imprécis : l’impression de maîtrise ne garantit pas le contrôle.

Une méfiance centrée sur la fiabilité

Le cœur du message de Wozniak tient en peu de mots. Il ne conteste pas seulement l’essor de l’IA. Il remet en cause sa capacité à inspirer confiance. Les utilisateurs, souligne-t-il, attendent d’un système qu’il saisisse le contexte, les nuances et l’intention. Or les modèles actuels excellent souvent dans la forme, mais trébuchent sur le fond.

Cette distinction compte. Une réponse bien rédigée peut masquer une erreur. Un système peut paraître assuré, tout en inventant une information. Dans des usages banals, le risque reste limité. Mais dans la santé, le droit, l’éducation ou la sécurité, cette faiblesse prend une autre dimension. Elle peut transformer un outil utile en source de confusion.

De plus, le scepticisme de Wozniak renvoie à une question plus large. À partir de quel seuil une technologie devient-elle assez fiable pour guider des décisions humaines ? Le débat ne porte plus seulement sur la performance, mais sur la responsabilité.

Une position qui s’est durcie en trois ans

La parole de Wozniak sur l’IA a évolué par étapes. En février 2023, il jugeait ne pas craindre l’IA tant que l’humain la créait et la programmait. À ce moment-là, il minimisait encore les menaces les plus extrêmes. Son point de départ restait technique : une machine conçue par l’homme reste, en principe, sous contrôle humain.

Cependant, le ton a changé en octobre 2025. Wozniak a alors signé une lettre ouverte du Future of Life Institute, qui réclamait l’arrêt du développement de la superintelligence artificielle. Le texte demandait une pause jusqu’à l’obtention d’un consensus scientifique sur la sécurité et le contrôle de ces systèmes. Plus de 800 à 900 signataires ont soutenu cet appel, dont Geoffrey Hinton, Yoshua Bengio et Stuart Russell.

Enfin, en mars 2026, Wozniak a réaffirmé son scepticisme. Il ne met pas en avant un scénario catastrophe précis. Il insiste plutôt sur les défauts visibles dès aujourd’hui : l’absence de compréhension réelle, la fragilité des réponses et le risque de confiance excessive. Son discours a donc glissé d’une prudence mesurée à une critique plus nette.

Le poids symbolique d’une voix fondatrice de la tech

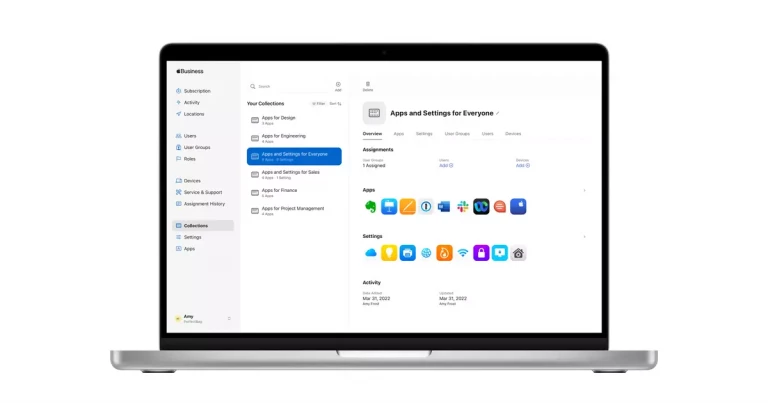

Cette prise de position résonne d’autant plus qu’elle vient d’un pionnier de la Silicon Valley. Wozniak incarne une époque où l’informatique personnelle visait d’abord à donner du pouvoir à l’utilisateur. À l’approche du 50e anniversaire d’Apple, le 1er avril 2026, il a rappelé que la naissance de l’entreprise relevait moins d’une prophétie que d’une intuition concrète. Il continue d’ailleurs à admirer Apple plus que toute autre entreprise technologique, malgré ses défauts.

Ce contexte éclaire sa critique. Wozniak n’attaque pas l’innovation comme un observateur extérieur. Il parle en ingénieur, habitué à juger une machine sur sa précision, sa robustesse et son utilité réelle. Son exigence reste celle des premiers bâtisseurs de l’informatique : un bon outil doit être compréhensible, prévisible et fiable.

Le Future of Life Institute alerte sur une « course incontrôlée »

L’appel lancé le 22 octobre 2025 par le Future of Life Institute a marqué un tournant. Le texte qualifie la construction d’une superintelligence de projet inacceptable sans cadre réglementaire solide. Ses auteurs évoquent une perte de contrôle sur des systèmes imprévisibles et mal compris. Ils citent aussi des risques graves : l’extinction humaine, la destruction d’emplois, l’érosion des libertés individuelles et des menaces pour la sécurité nationale.

Max Tegmark, président du FLI, a résumé cette ligne avec une formule claire : « Construire une telle chose est inacceptable » sans régulation, tout en soutenant des IA capables de guérir le cancer. Le texte mentionne aussi les biais absorbés sur Internet, notamment raciaux et sexistes, puis reproduits dans des décisions critiques.

Le prince Harry, autre signataire cité dans le rapport, a ajouté : « Le futur de l’IA doit servir l’humanité, pas la remplacer. » Cette phrase résume bien l’axe défendu par les critiques : ils ne rejettent pas tous les usages de l’IA, mais refusent une fuite en avant sans garde-fous.

Une fracture de plus en plus nette dans l’industrie

Le débat oppose désormais deux camps aux contours bien visibles. D’un côté, les critiques, parfois qualifiés d’« AI doomers », demandent de freiner la marche vers la superintelligence tant que la sécurité reste incertaine. De l’autre, les optimistes estiment que ces scénarios relèvent encore de l’hypothèse lointaine. Ils préfèrent concentrer les efforts sur les biais actuels, la transparence et l’impact économique.

Parmi les voix prudentes, on trouve donc Wozniak, Hinton, Bengio, Tegmark, ainsi que d’autres figures publiques. En face, des dirigeants comme Sam Altman estiment que l’AGI ou la superintelligence pourraient émerger en cinq ans. Yann LeCun, lui, juge la menace existentielle exagérée.

Cette division reflète un moment charnière. L’IA ne relève plus du laboratoire. Elle influence déjà les moteurs de recherche, les logiciels de bureau, le code, la création visuelle et les relations client. Le désaccord porte donc autant sur le futur que sur le présent.

Une course mondiale qui renforce l’urgence du débat

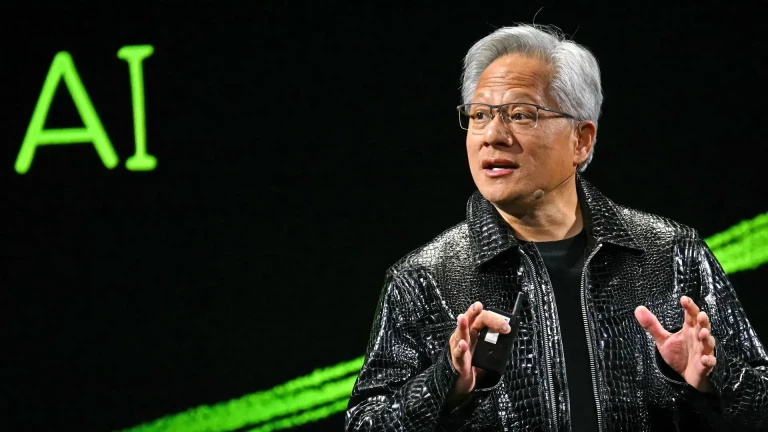

En parallèle, les grands groupes accélèrent. OpenAI vise la superintelligence à l’horizon de cinq ans. Google DeepMind cible l’AGI ou la superintelligence d’ici 2030, avec 75 milliards de dollars investis en 2025. D’autres acteurs, comme Meta et xAI, alimentent aussi cette compétition.

Cette dynamique nourrit l’inquiétude des partisans d’une pause. Plus la rivalité s’intensifie, plus la tentation grandit de lancer des systèmes imparfaits. Dans ce contexte, les réserves de Wozniak prennent une portée particulière. Il ne décrit pas seulement les défauts d’un produit. Il met en garde contre une logique industrielle où la vitesse menace d’écraser la prudence.

Au fond, son message reste simple. L’IA peut être brillante, utile et spectaculaire. Mais tant qu’elle n’offre ni fiabilité constante ni véritable compréhension, elle reste un outil à manier avec vigilance. Dans une industrie fascinée par la promesse de machines toujours plus puissantes, Wozniak rappelle une évidence souvent oubliée : la technologie vaut d’abord par la confiance qu’elle mérite.